Правило лопиталя производные лекция. Решение пределов онлайн. Применить правило Лопиталя самостоятельно, а затем посмотреть решение

Применение статистических методов при обработке материалов психологических исследований дает большую возможность извлечь из экспериментальных данных полезную информацию. Одним из самых распространенных методов статистики является корреляционный анализ.

Термин «корреляция» впервые применил французский палеонтолог Ж. Кювье, который вывел «закон корреляции частей и органов животных» (этот закон позволяет восстанавливать по найденным частям тела облик всего животного). В статистику указанный термин ввел английский биолог и статистик Ф. Гальтон (не просто «связь» – relation , а «как бы связь» – corelation ).

Корреляционный анализ – это проверка гипотез о связях между переменными с использованием коэффициентов корреляции, двумерной описательной статистики, количественной меры взаимосвязи (совместной изменчивости) двух переменных. Таким образом, это совокупность методов обнаружения корреляционной зависимости между случайными величинами или признаками.

Корреляционный анализ для двух случайных величин заключает в себе:

- построение корреляционного поля и составление корреляционной таблицы;

- вычисление выборочных коэффициентов корреляции и корреляционных отношений;

- проверку статистической гипотезы значимости связи.

Основное назначение корреляционного анализа – выявление связи между двумя или более изучаемыми переменными, которая рассматривается как совместное согласованное изменение двух исследуемых характеристик. Данная изменчивость обладает тремя основными характериcтиками: формой, направлением и силой.

По форме корреляционная связь может быть линейной или нелинейной. Более удобной для выявления и интерпретации корреляционной связи является линейная форма. Для линейной корреляционной связи можно выделить два основных направления: положительное («прямая связь») и отрицательное («обратная связь»).

Сила связи напрямую указывает, насколько ярко проявляется совместная изменчивость изучаемых переменных. В психологии функциональная взаимосвязь явлений эмпирически может быть выявлена только как вероятностная связь соответствующих признаков. Наглядное представление о характере вероятностной связи дает диаграмма рассеивания – график, оси которого соответствуют значениям двух переменных, а каждый испытуемый представляет собой точку.

В качестве числовой характеристики вероятностной связи используют коэффициенты корреляции, значения которых изменяются в диапазоне от –1 до +1. После проведения расчетов исследователь, как правило, отбирает только наиболее сильные корреляции, которые в дальнейшем интерпретируются (табл. 1).

Критерием для отбора «достаточно сильных» корреляций может быть как абсолютное значение самого коэффициента корреляции (от 0,7 до 1), так и относительная величина этого коэффициента, определяемая по уровню статистической значимости (от 0,01 до 0,1), зависящему от размера выборки. В малых выборках для дальнейшей интерпретации корректнее отбирать сильные корреляции на основании уровня статистической значимости. Для исследований, которые проведены на больших выборках, лучше использовать абсолютные значения коэффициентов корреляции.

Таким образом, задача корреляционного анализа сводится к установлению направления (положительное или отрицательное) и формы (линейная, нелинейная) связи между варьирующими признаками, измерению ее тесноты, и, наконец, к проверке уровня значимости полученных коэффициентов корреляции.

В настоящее время разработано множество различных коэффициентов корреляции. Наиболее применяемыми являются r -Пирсона, r -Спирмена и τ -Кендалла. Современные компьютерные статистические программы в меню «Корреляции» предлагают именно эти три коэффициента, а для решения других исследовательских задач предлагаются методы сравнения групп.

Выбор метода вычисления коэффициента корреляции зависит от типа шкалы, к которой относятся переменные (табл. 2).

Для переменных с интервальной и с номинальной шкалой используется коэффициент корреляции Пирсона (корреляция моментов произведений). Если, по меньшей мере, одна из двух переменных имеет порядковую шкалу или не является нормально распределенной, используется ранговая корреляция по Спирмену или

t-Кендалла. Если же одна из двух переменных является дихотомической, можно использовать точечную двухрядную корреляцию (в статистической компьютерной программе SPSS эта возможность отсутствует, вместо нее может быть применен расчет ранговой корреляции). В том случае если обе переменные являются дихотомическими, используется четырехполевая корреляция (данный вид корреляции рассчитываются SPSS на основании определения мер расстояния и мер сходства). Расчет коэффициента корреляции между двумя недихотомическими переменными возможен только тогда, кода связь между ними линейна (однонаправлена). Если связь, к примеру, U -образная (неоднозначная), коэффициент корреляции не пригоден для использования в качестве меры силы связи: его значение стремится к нулю.

Таким образом, условия применения коэффициентов корреляции будут следующими:

- переменные, измеренные в количественной (ранговой, метрической) шкале на одной и той же выборке объектов;

- связь между переменными является монотонной.

Основная статистическая гипотеза, которая проверяется корреляционным анализом, является ненаправленной и содержит утверждение о равенстве корреляции нулю в генеральной совокупности H 0: r xy = 0. При ее отклонении принимается альтернативная гипотеза H 1: r xy ≠ 0 о наличии положительной или отрицательной корреляции – в зависимости от знака вычисленного коэффициента корреляции.

На основании принятия или отклонения гипотез делаются содержательные выводы. Если по результатам статистической проверки H 0: r xy = 0 не отклоняется на уровне a, то содержательный вывод будет следующим: связь между X и Y не обнаружена. Если же при H 0 r xy = 0 отклоняется на уровне a, значит, обнаружена положительная (отрицательная) связь между X и Y . Однако к интерпретации выявленных корреляционных связей следует подходить осторожно. С научной точки зрения, простое установление связи между двумя переменными не означает существования причинно-следственных отношений. Более того, наличие корреляции не устанавливает отношения последовательности между причиной и следствием. Оно просто указывает, что две переменные взаимосвязаны между собой в большей степени, чем это можно ожидать при случайном совпадении. Тем не менее, при соблюдении осторожности применение корреляционных методов при исследовании причинно-следственных отношений вполне оправдано. Следует избегать категоричных фраз типа «переменная X является причиной увеличения показателя Y ». Подобные утверждения следует формулировать как предположения, которые должны быть строго обоснованы теоретически.

Подробное описание математической процедуры для каждого коэффициента корреляции дано в учебниках по математической статистике ; ; ; и др. Мы же ограничимся описанием возможности применения этих коэффициентов в зависимости от типа шкалы измерения.

Корреляция метрических переменных

Для изучения взаимосвязи двух метрических переменных, измеренных на одной и той же выборке, применяется коэффициент корреляции r -Пирсона . Сам коэффициент характеризует наличие только линейной связи между признаками, обозначаемыми, как правило, символами X и Y . Коэффициент линейной корреляции является параметрическим методом и его корректное применение возможно только в том случае, если результаты измерений представлены в шкале интервалов, а само распределение значений в анализируемых переменных отличается от нормального в незначительной степени. Существует множество ситуаций, в которых его применение целесообразно. Например: установление связи между интеллектом школьника и его успеваемостью; между настроением и успешностью выхода из проблемной ситуации; между уровнем дохода и темпераментом и т. п.

Коэффициент Пирсона находит широкое применение в психологии и педагогике. Например, в работах И. Я. Каплуновича и П. Д. Рабиновича, М. П. Нуждиной для подтверждения выдвинутых гипотез был использован расчет коэффициента линейной корреляции Пирсона.

При обработке данных «вручную» необходимо вычислить коэффициент корреляции, а затем определить p -уровень значимости (в целях упрощения проверки данных пользуются таблицами критических значений r xy , которые составлены с помощью этого критерия). Величина коэффициента линейной корреляции Пирсона не может превышать +1 и быть меньше чем –1. Эти два числа +1 и –1 являются границами для коэффициента корреляции. Когда при расчете получается величина, большая +1 или меньшая –1, это свидетельствует, что произошла ошибка в вычислениях.

При вычислениях на компьютере статистическая программа (SPSS, Statistica) сопровождает вычисленный коэффициент корреляции более точным значением p -уровня.

Для статистического решения о принятии или отклонении H 0 обычно устанавливают α = 0,05, а для большого объема наблюдений (100 и более) α = 0,01. Если p ≤ α, H 0 отклоняется и делается содержательный вывод, что обнаружена статистически достоверная (значимая) связь между изучаемыми переменными (положительная или отрицательная – в зависимости от знака корреляции). Когда p > α, H 0 не отклоняется, содержательный вывод ограничен констатацией, что связь (статистически достоверная) не обнаружена.

Если связь не обнаружена, но есть основания полагать, что связь на самом деле есть, следует проверить возможные причины недостоверности связи.

Нелинейность связи – для этого проанализировать график двумерного рассеивания. Если связь нелинейная, но монотонная, перейти к ранговым корреляциям. Если связь не монотонная, то делить выборку на части, в которых связь монотонная, и вычислить корреляции отдельно для каждой части выборки, или делить выборку на контрастные группы и далее сравнивать их по уровню выраженности признака.

Наличие выбросов и выраженная асимметрия распределения одного или обоих признаков. Для этого необходимо посмотреть гистограммы распределения частот обоих признаков. При наличии выбросов или асимметрии исключить выбросы или перейти к ранговым корреляциям.

Неоднородность выборки (проанализировать график двумерного рассеивания). Попытаться разделить выборку на части, в которых связь может иметь разные направления.

Если же связь статистически достоверна, то прежде чем делать содержательный вывод, необходимо исключить возможность ложной корреляции:

- связь обусловлена выбросами . При наличии выбросов перейти к ранговым корреляциям или исключить выбросы;

- связь обусловлена влиянием третьей переменной . Если есть подобное явление, необходимо вычислить корреляцию не только для всей выборки, но и для каждой группы в отдельности. Если «третья» переменная метрическая – вычислить частную корреляцию.

Коэффициент частной корреляции r xy -z вычисляется в том случае, если необходимо проверить предположение, что связь между двумя переменными X и Y не зависит от влияния третьей переменной Z . Очень часто две переменные коррелируют друг с другом только за счет того, что обе они согласованно меняются под влиянием третьей переменной. Иными словами, на самом деле связь между соответствующими свойствами отсутствует, но проявляется в статистической взаимосвязи под влиянием общей причины. Например, общей причиной изменчивости двух переменных может являться возраст при изучении взаимосвязи различных психологических особенностей в разновозрастной группе. При интерпретации частной корреляции с позиции причинности следует быть осторожным, так как если Z коррелирует и с X и с Y , а частная корреляция r xy -z близка к нулю, из этого не обязательно следует, что именно Z является общей причиной для X и Y .

Корреляция ранговых переменных

Если к количественным данным неприемлем коэффициент корреляции r -Пирсона , то для проверки гипотезы о связи двух переменных после предварительного ранжирования могут быть применены корреляции r -Спирмена или τ -Кендалла . Например, в исследовании психофизических особенностей музыкально одаренных подростков И. А. Лавочкина был использован критерий Спирмена.

Для корректного вычисления обоих коэффициентов (Спирмена и Кендалла) результаты измерений должны быть представлены в шкале рангов или интервалов. Принципиальных отличий между этими критериями не существует, но принято считать, что коэффициент Кендалла является более «содержательным», так как он более полно и детально анализирует связи между переменными, перебирая все возможные соответствия между парами значений. Коэффициент Спирмена более точно учитывает именно количественную степень связи между переменными.

Коэффициент ранговой корреляции Спирмена является непараметрическим аналогом классического коэффициента корреляции Пирсона, но при его расчете учитываются не связанные с распределением показатели сравниваемых переменных (среднее арифметическое и дисперсия), а ранги. Например, необходимо определить связь между ранговыми оценками качеств личности, входящими в представление человека о своем «Я реальном» и «Я идеальном».

Коэффициент Спирмена широко используется в психологических исследованиях. Например, в работе Ю. В. Бушова и Н. Н. Несмеловой : для изучения зависимости точности оценки и воспроизведения длительности звуковых сигналов от индивидуальных особенностей человека был использован именно он.

Так как этот коэффициент – аналог r -Пирсона, то и применение его для проверки гипотез аналогично применению коэффициента r -Пирсона. То есть проверяемая статистическая гипотеза, порядок принятия статистического решения и формулировка содержательного вывода – те же. В компьютерных программах (SPSS, Statistica) уровни значимости для одинаковых коэффициентов r -Пирсона и r -Спирмена всегда совпадают.

Преимущество коэффициента r -Спирмена по сравнению с коэффициентом r -Пирсона – в большей чувствительности к связи. Мы используем его в следующих случаях:

- наличие существенного отклонения распределения хотя бы одной переменной от нормального вида (асимметрия, выбросы);

- появление криволинейной (монотонной) связи.

Ограничением для применения коэффициента r -Спирмена являются:

- по каждой переменной не менее 5 наблюдений;

- коэффициент при большом количестве одинаковых рангов по одной или обеим переменным дает огрубленное значение.

Коэффициент ранговой корреляции τ -Кендалла является самостоятельным оригинальным методом, опирающимся на вычисление соотношения пар значений двух выборок, имеющих одинаковые или отличающиеся тенденции (возрастание или убывание значений). Этот коэффициент называют еще коэффициентом конкордации . Таким образом, основной идеей данного метода является то, что о направлении связи можно судить, попарно сравнивая между собой испытуемых: если у пары испытуемых изменение по X совпадает по направлению с изменением по Y , это свидетельствует о положительной связи, если не совпадает – об отрицательной связи, например, при исследовании личностных качеств, имеющих определяющее значение для семейного благополучия. В этом методе одна переменная представляется в виде монотонной последовательности (например, данные мужа) в порядке возрастания величин; другой переменной (например, данные жены) присваиваются соответствующие ранговые места. Количество инверсий (нарушений монотонности по сравнению с первым рядом) используется в формуле для корреляционных коэффициентов.

При подсчете τ- Кендалла «вручную» данные сначала упорядочиваются по переменной X . Затем для каждого испытуемого подсчитывается, сколько раз его ранг по Y оказывается меньше, чем ранг испытуемых, находящихся ниже. Результат записывается в столбец «Совпадения». Сумма всех значений столбца «Совпадение» и есть P – общее число совпадений, подставляется в формулу для вычисления коэффициента Кендалла, который более прост в вычислительном отношении, но при возрастании выборки, в отличие от r -Спирмена, объем вычислений возрастает не пропорционально, а в геометрической прогрессии. Так, например, при N = 12 необходимо перебрать 66 пар испытуемых, а при N = 489 – уже 1128 пар, т. е. объем вычислений возрастает более чем в 17 раз. При вычислениях на компьютере в статистической программе (SPSS, Statistica) коэффициент Кендалла обсчитывается аналогично коэффициентам r -Спирмена и r -Пирсона. Вычисленный коэффициент корреляции τ -Кендалла характеризуется более точным значением p -уровня.

Применение коэффициента Кендалла является предпочтительным, если в исходных данных имеются выбросы.

Особенностью ранговых коэффициентов корреляции является то, что максимальным по модулю ранговым корреляциям (+1, –1) не обязательно соответствуют строгие прямо или обратно пропорциональные связи между исходными переменными X и Y : достаточна лишь монотонная функциональная связь между ними. Ранговые корреляции достигают своего максимального по модулю значения, если большему значению одной переменной всегда соответствует большее значение другой переменной (+1), или большему значению одной переменной всегда соответствует меньшее значение другой переменной и наоборот (–1).

Проверяемая статистическая гипотеза, порядок принятия статистического решения и формулировка содержательного вывода те же, что и для случая r -Спирмена или r -Пирсона.

Если статистически достоверная связь не обнаружена, но есть основания полагать, что связь на самом деле есть, следует сначала перейти от коэффициента

r -Спирмена к коэффициенту τ -Кендалла (или наоборот), а затем проверить возможные причины недостоверности связи:

- нелинейность связи : для этого посмотреть график двумерного рассеивания. Если связь не монотонная, то делить выборку на части, в которых связь монотонная, или делить выборку на контрастные группы и далее сравнивать их по уровню выраженности признака;

- неоднородность выборки : посмотреть график двумерного рассеивания, попытаться разделить выборку на части, в которых связь может иметь разные направления.

Если же связь статистически достоверна, то прежде чем делать содержательный вывод, необходимо исключить возможность ложной корреляции (по аналогии с метрическими коэффициентами корреляции).

Корреляция дихотомических переменных

При сравнении двух переменных, измеренных в дихотомической шкале, мерой корреляционной связи служит так называемый коэффициент j, который представляет собой коэффициент корреляции для дихотомических данных.

Величина коэффициента φ лежит в интервале между +1 и –1. Он может быть как положительным, так и отрицательным, характеризуя направление связи двух дихотомически измеренных признаков. Однако интерпретация φ может выдвигать специфические проблемы. Дихотомические данные, входящие в схему вычисления коэффициента φ, не похожи на двумерную нормальную поверхность, следовательно, неправильно считать, что интерпретируемые значения r xy =0,60 и φ = 0,60 одинаковы. Коэффициент φ можно вычислить методом кодирования, а также используя так называемую четырехпольную таблицу или таблицу сопряженности.

Для применения коэффициента корреляции φ необходимо соблюдать следующие условия:

- сравниваемые признаки должны быть измерены в дихотомической шкале;

- X и Y должно быть одинаковым.

Данный вид корреляции рассчитывают в компьютерной программе SPSS на основании определения мер расстояния и мер сходства. Некоторые статистические процедуры, такие как факторный анализ, кластерный анализ, многомерное масштабирование, построены на применении этих мер, а иногда сами представляют добавочные возможности для вычисления мер подобия.

В тех случаях когда одна переменная измеряется в дихотомической шкале (переменная X ), а другая в шкале интервалов или отношений (переменная Y ), используется бисериальный коэффициент корреляции , например, при проверке гипотез о влиянии пола ребенка на показатель роста и веса. Этот коэффициент изменяется в диапазоне от –1 до +1, но его знак для интерпретации результатов не имеет значения. Для его применения необходимо соблюдать следующие условия:

- сравниваемые признаки должны быть измерены в разных шкалах: одна X – в дихотомической шкале; другая Y – в шкале интервалов или отношений;

- переменная Y имеет нормальный закон распределения;

- число варьирующих признаков в сравниваемых переменных X и Y должно быть одинаковым.

Если же переменная X измерена в дихотомической шкале, а переменная Y в ранговой шкале (переменная Y ), можно использовать рангово-бисериальный коэффициент корреляции , который тесно связан с τ-Кендалла и использует в своем определении понятия совпадения и инверсии. Интерпретация результатов та же.

Проведение корреляционного анализа с помощью компьютерных программ SPSS и Statistica – простая и удобная операция. Для этого после вызова диалогового окна Bivariate Correlations (Analyze>Correlate> Bivariate…) необходимо переместить исследуемые переменные в поле Variables и выбрать метод, с помощью которого будет выявляться корреляционная связь между переменными. В файле вывода результатов для каждого рассчитываемого критерия содержится квадратная таблица (Correlations). В каждой ячейке таблицы приведены: само значение коэффициента корреляции (Correlation Coefficient), статистическая значимость рассчитанного коэффициента Sig, количество испытуемых.

В шапке и боковой графе полученной корреляционной таблицы содержатся названия переменных. Диагональ (левый верхний – правый нижний угол) таблицы состоит из единиц, так как корреляция любой переменной с самой собой является максимальной. Таблица симметрична относительно этой диагонали. Если в программе установлен флажок «Отмечать значимые корреляции», то в итоговой корреляционной таблице будут отмечены статистически значимые коэффициенты: на уровне 0,05 и меньше – одной звездочкой (*), а на уровне 0,01 – двумя звездочками (**).

Итак, подведем итоги: основное назначение корреляционного анализа – это выявление связи между переменными. Мерой связи являются коэффициенты корреляции, выбор которых напрямую зависит от типа шкалы, в которой измерены переменные, числа варьирующих признаков в сравниваемых переменных и распределения переменных. Наличие корреляции двух переменных еще не означает, что между ними существует причинная связь. Хотя корреляция прямо не указывает на причинную связь, она может быть ключом к разгадке причин. На ее основе можно сформировать гипотезы. В некоторых случаях отсутствие корреляции имеет более глубокое воздействие на гипотезу о причинной связи. Нулевая корреляция двух переменных может свидетельствовать, что никакого влияния одной переменной на другую не существует.

В научных исследованиях часто возникает необходимость в нахождении связи между результативными и факторными переменными (урожайностью какой-либо культуры и количеством осадков, ростом и весом человека в однородных группах по полу и возрасту, частотой пульса и температурой тела и т.д.).

Вторые представляют собой признаки, способствующие изменению таковых, связанных с ними (первыми).

Понятие о корреляционном анализе

Существует множество Исходя из вышеизложенного, можно сказать, что корреляционный анализ — это метод, применяющийся с целью проверки гипотезы о статистической значимости двух и более переменных, если исследователь их может измерять, но не изменять.

Есть и другие определения рассматриваемого понятия. Корреляционный анализ — это метод обработки заключающийся в изучении коэффициентов корреляции между переменными. При этом сравниваются коэффициенты корреляции между одной парой или множеством пар признаков, для установления между ними статистических взаимосвязей. Корреляционный анализ — это метод по изучению статистической зависимости между случайными величинами с необязательным наличием строгого функционального характера, при которой динамика одной случайной величины приводит к динамике математического ожидания другой.

Понятие о ложности корреляции

При проведении корреляционного анализа необходимо учитывать, что его можно провести по отношению к любой совокупности признаков, зачастую абсурдных по отношению друг к другу. Порой они не имеют никакой причинной связи друг с другом.

В этом случае говорят о ложной корреляции.

Задачи корреляционного анализа

Исходя из приведенных выше определений, можно сформулировать следующие задачи описываемого метода: получить информацию об одной из искомых переменных с помощью другой; определить тесноту связи между исследуемыми переменными.

Корреляционный анализ предполагает определение зависимости между изучаемыми признаками, в связи с чем задачи корреляционного анализа можно дополнить следующими:

- выявление факторов, оказывающих наибольшее влияние на результативный признак;

- выявление неизученных ранее причин связей;

- построение корреляционной модели с ее параметрическим анализом;

- исследование значимости параметров связи и их интервальная оценка.

Связь корреляционного анализа с регрессионным

Метод корреляционного анализа часто не ограничивается нахождением тесноты связи между исследуемыми величинами. Иногда он дополняется составлением уравнений регрессии, которые получают с помощью одноименного анализа, и представляющих собой описание корреляционной зависимости между результирующим и факторным (факторными) признаком (признаками). Этот метод в совокупности с рассматриваемым анализом составляет метод

Условия использования метода

Результативные факторы зависят от одного до нескольких факторов. Метод корреляционного анализа может применяться в том случае, если имеется большое количество наблюдений о величине результативных и факторных показателей (факторов), при этом исследуемые факторы должны быть количественными и отражаться в конкретных источниках. Первое может определяться нормальным законом — в этом случае результатом корреляционного анализа выступают коэффициенты корреляции Пирсона, либо, в случае, если признаки не подчиняются этому закону, используется коэффициент ранговой корреляции Спирмена.

Правила отбора факторов корреляционного анализа

При применении данного метода необходимо определиться с факторами, оказывающими влияние на результативные показатели. Их отбирают с учетом того, что между показателями должны присутствовать причинно-следственные связи. В случае создания многофакторной корреляционной модели отбирают те из них, которые оказывают существенное влияние на результирующий показатель, при этом взаимозависимые факторы с коэффициентом парной корреляции более 0,85 в корреляционную модель предпочтительно не включать, как и такие, у которых связь с результативным параметром носит непрямолинейный или функциональный характер.

Отображение результатов

Результаты корреляционного анализа могут быть представлены в текстовом и графическом видах. В первом случае они представляются как коэффициент корреляции, во втором — в виде диаграммы разброса.

При отсутствии корреляции между параметрами точки на диаграмме расположены хаотично, средняя степень связи характеризуется большей степенью упорядоченности и характеризуется более-менее равномерной удаленностью нанесенных отметок от медианы. Сильная связь стремится к прямой и при r=1 точечный график представляет собой ровную линию. Обратная корреляция отличается направленностью графика из левого верхнего в нижний правый, прямая — из нижнего левого в верхний правый угол.

Трехмерное представление диаграммы разброса (рассеивания)

Помимо традиционного 2D-представления диаграммы разброса в настоящее время используется 3D-отображение графического представления корреляционного анализа.

Также используется матрица диаграммы рассеивания, которая отображает все парные графики на одном рисунке в матричном формате. Для n переменных матрица содержит n строк и n столбцов. Диаграмма, расположенная на пересечении i-ой строки и j-ого столбца, представляет собой график переменных Xi по сравнению с Xj. Таким образом, каждая строка и столбец являются одним измерением, отдельная ячейка отображает диаграмму рассеивания двух измерений.

Оценка тесноты связи

Теснота корреляционной связи определяется по коэффициенту корреляции (r): сильная — r = ±0,7 до ±1, средняя — r = ±0,3 до ±0,699, слабая — r = 0 до ±0,299. Данная классификация не является строгой. На рисунке показана несколько иная схема.

Пример применения метода корреляционного анализа

В Великобритании было предпринято любопытное исследование. Оно посвящено связи курения с раком легких, и проводилось путем корреляционного анализа. Это наблюдение представлено ниже.

Профессиональная группа | смертность |

|

Фермеры, лесники и рыбаки | ||

Шахтеры и работники карьеров | ||

Производители газа, кокса и химических веществ | ||

Изготовители стекла и керамики | ||

Работники печей, кузнечных, литейных и прокатных станов | ||

Работники электротехники и электроники | ||

Инженерные и смежные профессии | ||

Деревообрабатывающие производства | ||

Кожевенники | ||

Текстильные рабочие | ||

Изготовители рабочей одежды | ||

Работники пищевой, питьевой и табачной промышленности | ||

Производители бумаги и печати | ||

Производители других продуктов | ||

Строители | ||

Художники и декораторы | ||

Водители стационарных двигателей, кранов и т. д. | ||

Рабочие, не включенные в другие места | ||

Работники транспорта и связи | ||

Складские рабочие, кладовщики, упаковщики и работники разливочных машин | ||

Канцелярские работники | ||

Продавцы | ||

Работники службы спорта и отдыха | ||

Администраторы и менеджеры | ||

Профессионалы, технические работники и художники |

Начинаем корреляционный анализ. Решение лучше начинать для наглядности с графического метода, для чего построим диаграмму рассеивания (разброса).

Она демонстрирует прямую связь. Однако на основании только графического метода сделать однозначный вывод сложно. Поэтому продолжим выполнять корреляционный анализ. Пример расчета коэффициента корреляции представлен ниже.

С помощью программных средств (на примере MS Excel будет описано далее) определяем коэффициент корреляции, который составляет 0,716, что означает сильную связь между исследуемыми параметрами. Определим статистическую достоверность полученного значения по соответствующей таблице, для чего нам нужно вычесть из 25 пар значений 2, в результате чего получим 23 и по этой строке в таблице найдем r критическое для p=0,01 (поскольку это медицинские данные, здесь используется более строгая зависимость, в остальных случаях достаточно p=0,05), которое составляет 0,51 для данного корреляционного анализа. Пример продемонстрировал, что r расчетное больше r критического, значение коэффициента корреляции считается статистически достоверным.

Использование ПО при проведении корреляционного анализа

Описываемый вид статистической обработки данных может осуществляться с помощью программного обеспечения, в частности, MS Excel. Корреляционный предполагает вычисление следующих парамет-ров с использованием функций:

1. Коэффициент корреляции определяется с помощью функции КОРРЕЛ (массив1; массив2). Массив1,2 — ячейка интервала значений результативных и факторных переменных.

Линейный коэффициент корреляции также называется коэффициентом корреляции Пирсона, в связи с чем, начиная с Excel 2007, можно использовать функцию с теми же массивами.

Графическое отображение корреляционного анализа в Excel производится с помощью панели «Диаграммы» с выбором «Точечная диаграмма».

После указания исходных данных получаем график.

2. Оценка значимости коэффициента парной корреляции с использованием t-критерия Стьюдента. Рассчитанное значение t-критерия сравнивается с табличной (критической) величиной данного показателя из соответствующей таблицы значений рассматриваемого параметра с учетом заданного уровня значимости и числа степеней свободы. Эта оценка осуществляется с использованием функции СТЬЮДРАСПОБР (вероятность; степени_свободы).

3. Матрица коэффициентов парной корреляции. Анализ осуществляется с помощью средства «Анализ данных», в котором выбирается «Корреляция». Статистическую оценку коэффициентов парной корреляции осуществляют при сравнении его абсолютной величины с табличным (критическим) значением. При превышении расчетного коэффициента парной корреляции над таковым критическим можно говорить, с учетом заданной степени вероятности, что нулевая гипотеза о значимости линейной связи не отвергается.

В заключение

Использование в научных исследованиях метода корреляционного анализа позволяет определить связь между различными факторами и результативными показателями. При этом необходимо учитывать, что высокий коэффициент корреляции можно получить и из абсурдной пары или множества данных, в связи с чем данный вид анализа нужно осуществлять на достаточно большом массиве данных.

После получения расчетного значения r его желательно сравнить с r критическим для подтверждения статистической достоверности определенной величины. Корреляционный анализ может осуществляться вручную с использованием формул, либо с помощью программных средств, в частности MS Excel. Здесь же можно построить диаграмму разброса (рассеивания) с целью наглядного представления о связи между изучаемыми факторами корреляционного анализа и результативным признаком.

Понятие взаимосвязи довольно распространено в психологических исследованиях. С ним приходится оперировать психологу тогда, когда появляется необходимость сопоставить измерения двух или нескольких показателей признаков или явлений, чтобы сделать какие-либо выводы.

Характер взаимосвязи между изучаемыми явлениями может быть однозначным, т.е. таким, когда определенному значению одною признака соответствует четкое и определенное значение другого. Так, например, в субтесте на поиск закономерностей тестов психических функций количество набранных «сырых» баллов определяется по формуле:

Xi = Sтз - Sоз / Sтз + Sпз * Sbс,

где Xi - значение варианты, Sтз - количество априорно заданных закономерностей (соответствий) в субтесте, Sоз - количество ошибочно указанных соответствий испытуемым, Sоз - количество не указанных (пропущенных) соответствий испытуемым, Sbс - количество всех просмотренных испытуемыми слов в тесте.

Такая взаимосвязь получила название функциональной: здесь один показатель является функцией другого, который представляет собой аргумент по отношению к первому.

Однако однозначная четкая взаимосвязь встречается не всегда. Чаще приходится сталкиваться с таким положением, при котором одному значению признака могут соответствовать несколько значений другого. Эти значения варьируют в пределах более или менее очерченных границ. Такой вид взаимосвязи получил название корреляционной или соотносительной.

Применяется несколько видов выражения корреляционной взаимосвязи. Так, для выражения взаимосвязи между признаками, имеющими количественный характер варьирования своих значений, используют меры центральной тенденции: табулирование с последующим вычислением коэффициента парной корреляции, коэффициент множественной и частной корреляции, коэффициент множественной детерминации, корреляционное отношение.

Если необходимо изучить взаимосвязь между признаками, варьирование которых носит качественный характер (результаты проективных методов исследования личности, исследования по методу Семантического дифференциала, исследования с использованием Открытых шкал и т.д.), то используют коэффициент качественной альтернативной корреляции (тетрахорический показатель), критерий Пирсона x2, показатели сопряженности (контингенции) Пирсона и Чупрова.

Для определения качественно-количественной корреляции, т.е. такой корреляции, когда один признак имеет качественное варьирование, а другой - количественное.применяются специальные методы.

Коэффициент корреляции (термин впервые введен Ф. Гальто-ном в 1888 г.) - показатель силы связи между двумя сопоставляемыми вариантами выборки (выборок). По какой бы формуле не вычислялся коэффициент корреляции, его величина колеблется в пределах от -1 до +1. В случае полной положительной корреляции этот коэффициент равен плюс 1, а при полной отрицательной - минус 1. Обычно это прямая линия, проходящая через точки пересечения значений каждой пары данных.

Если значения вариант не выстраиваются на прямой, а образуют «облако», то коэффициент корреляции по абсолютной величине становится меньше единицы и по мере округления «облака» приближается к нулю. Если коэффициент корреляции равен 0, обе варианты полностью независимы друг от друга.

Всякое вычисленное (эмпирическое) значение коэффициента корреляции должно быть проверено на достоверность (статистическую значимость) по соответствующим таблицам критических значений коэффициента корреляции. Если эмпирическое значение меньше или равно табличному для 5-процентного уровня (Р = 0,05), корреляция не является значимой. Если вычисленное значение коэффициента корреляции больше табличного для Р = 0,01, корреляция статистически значима (достоверна).

В случае, когда величина коэффициента заключена между 0,05 > Р > 0.01, на практике говорят о значимости корреляции для Р = 0,05.

Коэффициент корреляции Браве-Пирсона (г) - это предложенный в 1896 г. параметрический показатель, для вычисления которого сравнивают средние арифметические и средние квадратические значения вариант. Для вычисления этого коэффициента применяют следующую формулу (у разных авторов она может выглядеть по-разному):

r= (E Xi Xi1) - NXap X1ap / N-1 Qx Qx1,

где E Xi Xi1 - сумма произведений значений попарно сопоотавимых вариантов, n-колличество сравниваемых пар, NXap, X1ap - средние арифметические вариант Xi, Xi; соответственно, Qx, Qx, -средние квадратические отклонения распределений х и х.

Коэффициент корреляции рангов Спирмена Rs (коэффициент ранговой корреляции, коэффициент Спирмена) является простейшей формой коэффициента корреляции и измеряет связь между рангами (местами) данной варианты по разным признакам, не учитывая ее собственного значения. Здесь исследуется скорее качественная связь, чем количественная.

Обычно этот непараметрический критерий используется в случаях, когда нужно сделать выводы не столько об интервалах между данными, сколько об их рангах, а также тогда, когда кривые распределения крайне асимметричны и не позволяют использовать такие параметрические критерии, как коэффициент корреляции Браве-Пирсона (в этих случаях бывает необходимо превратить количественные данные в порядковые). Если коэффициент Rs близок к +1, то это означает, что два ряда ранжированной по тем или иным признакам выборки практически совпадают, а если этот коэффициент близок к - 1, можно говорить о полной обратной зависимости.

Как и вычисление коэффициента корреляции Браве-Пирсона, вычисления коэффициента Rs удобнее представлять в табличной форме.

Регрессия обобщает понятие функциональной взаимосвязи на случай стохастического (вероятностного) характера зависимости между значениями вариант. Целью решения категории регрессионных задач является оценка значения непрерывной выходной вариативности по значениям входных вариант.

В статье рассматриваются определения корреляции,корреляционного анализа и коэффициента корреляции. Дается определение корреляционной связи и ее основных характеристик.

- Корреляционно-регрессионный анализ в исследовании факторов рождаемости

- Оценка факторов рождаемости в Республике Башкортостан

Исследователей нередко интересует, как связаны между собой две или большее количество переменных в одной или нескольких изучаемых выборках. Например, такая связь может наблюдаться между погрешностью аппаратной обработки экспериментальных данных и величиной скачков сетевого напряжения. Другим примером может служить связь между пропускной способностью канала передачи данных и соотношением сигнал/шум.

В 1886 году английский естествоиспытатель Френсис Гальтон для обозначения характера подобного рода взаимодействий ввёл термин «корреляция». Позже его ученик Карл Пирсон разработал математическую формулу, позволяющую дать количественную оценку корреляционным связям признаков.

Зависимости между величинами (факторами, признаками) разделяют на два вида: функциональную и статистическую.

При функциональных зависимостях каждому значению одной переменной величины соответствует определенное значение другой переменной. Кроме того, функциональная связь двух факторов возможна только при условии, что вторая величина зависит только от первой и не зависит ни от каких других величин. В случае зависимости величины от множества факторов, функциональная связь возможна, если первая величина не зависит ни от каких других факторов, кроме входящих в указанное множество.

При статистической зависимости изменение одной из величин влечёт изменение распределения других величин, которые с определенными вероятностями принимают некоторые значения.

Значительно больший интерес представляет другой частный случай статистической зависимости, когда существует взаимосвязь значений одних случайных величин со средним значением других, при той особенности, что в каждом отдельном случае любая из взаимосвязанных величин может принимать различные значения.

Такого рода зависимость между переменными величинами называется корреляционной, или корреляцией.

Корреляционный анализ - метод, позволяющий обнаружить зависимость между несколькими случайными величинами.

Корреляционный анализ решает две основные задачи:

- Первая задача заключается в определении формы связи, т.е. в установлении математической формы, в которой выражается данная связь. Это очень важно, так как от правильного выбора формы связи зависит конечный результат изучения взаимосвязи между признаками.

- Вторая задача состоит в измерении тесноты, т.е. меры связи между признаками с целью установить степень влияния данного фактора на результат. Она решается математически путем определения параметров корреляционного уравнения.

Затем проводятся оценка и анализ полученных результатов при помощи специальных показателей корреляционного метода (коэффициентов детерминации, линейной и множественной корреляции и т.д.), а также проверка существенности связи между изучаемыми признаками.

Методами корреляционного анализа решаются следующие задачи:

- Взаимосвязь. Есть ли взаимосвязь между параметрами?

- Прогнозирование. Если известно поведение одного параметра, то можно предсказать поведение другого параметра, коррелирующего с первым.

- Классификация и идентификация объектов. Корреляционный анализ помогает подобрать набор независимых признаков для классификации.

Корреляция - статистическая взаимосвязь двух или нескольких случайных величин (либо величин, которые можно с некоторой допустимой степенью точности считать таковыми). Суть ее заключается в том, что при изменении значения одной переменной происходит закономерное изменение (уменьшению или увеличению) другой переменной.

Для определения наличия взаимосвязи между двумя свойствами используется коэффициент корреляции.

Коэффициент корреляции р для генеральной совокупности, как правило, неизвестен, поэтому он оценивается по экспериментальным данным, представляющим собой выборку объема n пар значений (x i , y i), полученную при совместном измерении двух признаков Х и Y. Коэффициент корреляции, определяемый по выборочным данным, называется выборочным коэффициентом корреляции (или просто коэффициентом корреляции). Его принято обозначать символом r.

К основным свойствам коэффициента корреляции относятся:

- Коэффициенты корреляции способны характеризовать только линейные связи, т.е. такие, которые выражаются уравнением линейной функции. При наличии нелинейной зависимости между варьирующими признаками следует использовать другие показатели связи.

- Значения коэффициентов корреляции – это отвлеченные числа, лежащее в пределах от -1 до +1, т.е. -1 < r < 1.

- При независимом варьировании признаков, когда связь между ними отсутствует, r = 0 .

- При положительной, или прямой, связи, когда с увеличением значений одного признака возрастают значения другого, коэффициент корреляции приобретает положительный (+) знак и находится в пределах от 0 до +1, т.е. 0 < r < 1.

- При отрицательной, или обратной, связи, когда с увеличением значений одного признака соответственно уменьшаются значения другого, коэффициент корреляции сопровождается отрицательным (–) знаком и находится в пределах от 0 до –1, т.е. -1 < r <0.

- Чем сильнее связь между признаками, тем ближе величина коэффициента корреляции к ô1ô. Если r = ± 1, то корреляционная связь переходит в функциональную, т.е. каждому значению признака Х будет соответствовать одно или несколько строго определенных значений признака Y.

- Только по величине коэффициентов корреляции нельзя судить о достоверности корреляционной связи между признаками. Этот параметр зависит от числа степеней свободы k = n –2, где: n – число коррелируемых пар показателей Х и Y. Чем больше n, тем выше достоверность связи при одном и том же значении коэффициента корреляции.

Рассчитывается коэффициент корреляции по следующей формуле:

где x - значение факторного признака; y - значение результативного признака; n - число пар данных.

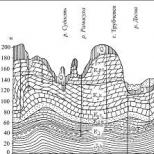

Корреляция изучается на основании экспериментальных данных, представляющих собой измеренные значения x i ,y i двух признаков x,y. Если экспериментальных данных сравнительно немного, то двумерное эмпирическое распределение представляется в виде двойного ряда значений x i ,y i . При этом корреляционную зависимость между признаками можно описывать разными способами. Соответствие между аргументом и функцией может быть задано таблицей, формулой, графиком и т. д.

Когда исследуется корреляция между количественными признаками, значения которых можно точно измерить в единицах метрических шкал, то очень часто принимается модель двумерной нормально распределенной генеральной совокупности. Такая модель отображает зависимость между переменными величинами x и y графически в виде геометрического места точек в системе прямоугольных координат. Эта графическая зависимость называется диаграммой рассеивания или корреляционным полем.

Данная модель двумерного нормального распределения (корреляционное поле) позволяет дать наглядную графическую интерпретацию коэффициента корреляции, т.к. распределение в совокупности зависит от пяти параметров:

- математических ожиданий E[x], E[y] величин x,y;

- стандартных отклонений px, py случайных величин x,y ;

- коэффициента корреляции p , который является мерой связи между случайными величинами, х и у. Приведем примеры корреляционных полей.

Если р = 0, то значения x i ,y i , полученные из двумерной нормальной совокупности, располагаются на графике в пределах области, ограниченной окружностью. В этом случае между случайными величинами x и y отсутствует корреляция, и они называются некоррелированными. Для двумерного нормального распределения некоррелированность означает одновременно и независимость случайных величин x и y.

Если р = 1 или р = -1, то говорят о полной корреляции, то есть между случайными величинами x и y существует линейная функциональная зависимость.

При р = 1 значения x i ,y i определяют точки, лежащие на прямой линии, имеющей положительный наклон (с увеличением x i значения y i также увеличиваются).

В промежуточных случаях, когда -1< p <1, определяемые значениями x i ,y i точки попадают в область, ограниченную некоторым эллипсом, причём при p>0 имеет место положительная корреляция (с увеличением x значения y в целом имеют тенденцию к возрастанию), при p<0 корреляция отрицательная. Чем ближе p к ±1, тем уже эллипс и тем теснее точки, определяемые экспериментальными значениями, группируются около прямой линии.

Здесь же следует обратить внимание на то, что линия, вдоль которой группируются точки, может быть не только прямой, а иметь любую другую форму: парабола, гипербола и т. д. В этих случаях рассматривают нелинейную корреляцию.

Корреляционную зависимость между признаками можно описывать разными способами, в частности, любая форма связи может быть выражена уравнением общего вида y=f(x), где признак y – зависимая переменная, или функция от независимой переменной x, называемой аргументом.

Таким образом, визуальный анализ корреляционного поля помогает определить не только наличие статистической связи (линейной или нелинейной) между исследуемыми признаками, но и ее тесноту и форму.

При изучении корреляционной связи важным направлением анализа является оценка степени тесноты связи. Понятие степени тесноты связи между двумя признаками возникает вследствие того, что в действительности на изменение результативного признака влияет множество факторов. При этом влияние одного из факторов может выражаться более заметно и четко, чем влияние других факторов. С изменением условий роль решающего фактора может перейти к другому признаку.

При статистическом изучении взаимосвязей, как правило, учитываются только основные факторы. Также с учетом степени тесноты связи оценивается необходимость более подробного изучения конкретной данной связи и значение практического ее использования.

В общем, знание количественной оценки тесноты корреляционной связи позволяет решить следующую группу вопросов:

- необходимость глубокого изучения данной связи между признаками и целесообразность ее практического применения;

- степень различий в проявлении связи в конкретных условиях (сопоставление оценки тесноты связи для различных условий);

- выявление главных и второстепенных факторов в данных конкретных условиях путём последовательного рассмотрения и сравнения признака с различными факторами.

Показатели тесноты связи должны удовлетворять ряду основных требований:

- величина показателя тесноты связи должна быть равна или близка к нулю, если связь между изучаемыми признаками (процессами, явлениями) отсутствует;

- при наличии между изучаемыми признаками функциональной связи величина показателя тесноты связи должна быть равна единице;

- при наличии между признаками корреляционной связи абсолютное значение показателя тесноты связи должно выражаться правильной дробью, которая по величине тем больше, чем теснее связь между изучаемыми признаками (стремится к единице).

Корреляционная зависимость определяется различными параметрами, среди которых наибольшее распространение получили парные показатели, характеризующие взаимосвязь двух случайных величин: коэффициент ковариации (корреляционный момент) и линейный коэффициент корреляции (коэффициент корреляции Пирсона).

Сила связи определяется абсолютным значением показателя тесноты связи и не зависит от направления связи.

В зависимости от абсолютного значения коэффициента корреляции p корреляционные связи между признаками по силе делятся следующим образом:

- сильная, или тесная (при p >0,70);

- средняя (при 0,50< p <0,69);

- умеренная (при 0,30< p <0,49);

- слабая (при 0,20< p <0,29);

- очень слабая (при p <0,19).

По форме корреляционная связь может быть линейной или нелинейной.

Линейной может быть, например, связь между уровнем подготовки студента и оценками итоговой аттестации. Пример нелинейной связи - уровень мотивации и эффективность выполнения поставленной задачи. (При повышении мотивации эффективность выполнения задачи сначала возрастает, затем, при определённом уровне мотивации, достигается максимальная эффективность; но дальнейшему повышению мотивации сопутствует уже снижение эффективности.)

По направлению корреляционная связь может быть положительной (прямой) и отрицательной (обратной).

При положительной линейной корреляции более высоким значениям одного признака соответствуют более высокие значения другого, а более низким значениям одного признака - более низкие значения другого. При отрицательной корреляции соотношения обратные.

Знак коэффициента корреляции зависит от направления корреляционной связи: при положительной корреляции коэффициент корреляции имеет положительный знак, при отрицательной корреляции - отрицательный знак.

Список литературы

- Аблеева, А. М. Формирование фонда оценочных средств в условиях ФГОС [Текст] / А. М. Аблеева, Г. А. Салимова // Актуальные проблемы преподавания социально-гуманитарных, естественно - научных и технических дисциплин в условиях модернизации высшей школы: материалы международной научно-методической конференции, 4-5 апреля 2014 г. / Башкирский ГАУ, Факультет информационных технологий и управления. - Уфа, 2014. - С. 11-14.

- Ганиева, А.М. Статистический анализ занятости и безработицы [Текст] / А.М. Ганиева, Т.Н. Лубова // Актуальные вопросы экономико-статистического исследования и информационных технологий: сб. науч. ст.: посвящается к 40-летию создания кафедры "Статистики и информационных систем в экономике" / Башкирский ГАУ. - Уфа, 2011. - С. 315-316.

- Исмагилов, Р. Р. Творческая группа - эффективная форма организации научных исследований в высшей школе [Текст] / Р. Р. Исмагилов, М. Х. Уразлин, Д. Р. Исламгулов // Научно-технический и научно-образовательный комплексы региона: проблемы и перспективы развития: материалы научно-практической конференции / Академия наук РБ, УГАТУ. - Уфа, 1999. - С. 105-106.

- Исламгулов, Д.Р. Компетентностный подход в обучении: оценка качества образования [Текст] / Д.Р. Исламгулов, Т.Н. Лубова, И.Р. Исламгулова // Современный научный вестник. – 2015. – Т. 7. - № 1. – С. 62-69.

- Исламгулов, Д. Р. Научно-исследовательская работа студентов - важнейший элемент подготовки специалистов в аграрном вузе [Текст] / Д. Р. Исламгулов // Проблемы практической подготовки студентов в вузе на современном этапе и пути их решения: сб. материалов науч.-метод. конф., 24 апреля 2007 года / Башкирский ГАУ. - Уфа, 2007. - С. 20-22.

- Лубова, Т.Н. Основа реализации федерального государственного образовательного стандарта – компетентностный подход [Текст] / Т.Н. Лубова, Д.Р. Исламгулов, И.Р. Исламгулова// БЪДЕЩИТЕ ИЗСЛЕДОВАНИЯ – 2016: Материали за XII Международна научна практична конференция, 15-22 февруари 2016. – София: Бял ГРАД-БГ ООД, 2016. – Том 4 Педагогически науки. – C. 80-85.

- Лубова, Т.Н. Новые образовательные стандарты: особенности реализации [Текст] / Т.Н. Лубова, Д.Р. Исламгулов // Современный научный вестник. – 2015. – Т. 7. - № 1. – С. 79-84.

- Лубова, Т.Н. Организация самостоятельной работы обучающихся [Текст] / Т.Н. Лубова, Д.Р. Исламгулов // Реализация образовательных программ высшего образования в рамках ФГОС ВО: материалы Всероссийской научно-методической конференции в рамках выездного совещания НМС по природообустройству и водопользованию Федерального УМО в системе ВО. / Башкирский ГАУ. - Уфа, 2016. - С. 214-219.

- Лубова, Т.Н. Основа реализации федерального государственного образовательного стандарта – компетентностный подход [Текст] / Т.Н. Лубова, Д.Р. Исламгулов, И.Р. Исламгулова // Современный научный вестник. – 2015. – Т. 7. - № 1. – С. 85-93.

- Саубанова, Л.М. Уровень демографической нагрузки [Текст] / Л.М. Саубанова, Т.Н. Лубова // Актуальные вопросы экономико-статистического исследования и информационных технологий: сб. науч. ст.: посвящается к 40-летию создания кафедры "Статистики и информационных систем в экономике" / Башкирский ГАУ. - Уфа, 2011. - С. 321-322.

- Фахруллина, А.Р. Статистический анализ инфляции в России [Текст] / А.Р. Фахруллина, Т.Н. Лубова // Актуальные вопросы экономико-статистического исследования и информационных технологий: сб. науч. ст.: посвящается к 40-летию создания кафедры "Статистики и информационных систем в экономике" / Башкирский ГАУ. - Уфа, 2011. - С. 323-324.

- Фархутдинова, А.Т. Рынок труда в Республике Башкортостан в 2012 году [Электронный ресурс] / А.Т. Фархутдинова, Т.Н. Лубова // Студенческий научный форум. Материалы V Международной студенческой электронной научной конференции: электронная научная конференция (электронный сборник). Российская академия естествознания. 2013.