Корреляционный анализ выявляет. Корреляционный анализ спирмена. Корреляция метрических переменных

Исследование объективно существующих связей между явлениями - важнейшая задача статистики. В процессе статистического исследования зависимостей выявляются причинно-следственные отношения между явлениями. Причинно-следственные отношения - это такая связь явлений и процессов, когда изменение одного из них - причины ведет к изменению другого - следствия.

Признаки явлений и процессов по их значению для изучения взаимосвязи делятся на два класса. Признаки, обуславливающие изменения других, связанных с ними признаков, называют факторными , или просто факторами. Признаки, изменяющиеся под действием факторных признаков, называют результативными .

В статистике различают функциональные и стохастические (вероятностные) связи явлений и процессов:

- Функциональной называют такую связь, при которой определенному значению факторного признака соответствует одно значение результативного.

- Если причинная зависимость проявляется не в каждом отдельном случае, а в общем, среднем при большом числе наблюдений, то такая зависимость называется стохастической (вероятностной) . Частным случаем стохастической связи является корреляционная связь.

Кроме того, связи между явлениями и их признаками классифицируются по степени тесноты, направлению и аналитическому выражению.

По направлению выделяют связь прямую и обратную:

- Прямая связь - это такая связь, при которой с увеличением (уменьшением) значений факторного признака происходит увеличение (уменьшение) значений результативного. Так, например, рост производительности труда способствует увеличению уровня рентабельности производства.

- В случае обратной связи значения результативного признака изменяются под воздействием факторного, но в противоположном направлении по сравнению с изменением факторного признака. Так с увеличением уровня фондоотдачи снижается себестоимость единицы производимой продукции.

По аналитическому выражению выделяют связи прямолинейные (или просто линейные) и нелинейные:

- Если статистическая связь между явлениями может быть приблизительно выражена уравнением прямой линии, то ее называют линейной связью вида: у=а+bх.

- Если же связь может быть выражена уравнением какой-либо кривой линии (параболы, гиперболы и др.), то такую связь называют нелинейной (криволинейной) связью .

Теснота связи показывает меру влияния факторного признака на общую вариацию результативного признака. Классификация связи по степени тесноты представлена в таблице 1.

Для выявления наличия связи, ее характера и направления в статистике используются следующие методы: приведения параллельных данных, аналитических группировок, графический, корреляции. Основным методом изучения статистической взаимосвязи является статистическое моделирование связи на основе корреляционного и регрессионного анализа .

Корреляция - это статистическая зависимость между случайными величинами, не имеющая строго функционального характера, при которой изменение одной из случайных величин приводит к изменению математического ожидания другой. В статистике принято различать следующие виды корреляции :

- парная корреляция - связь между двумя признаками (результативным и факторным, или двумя факторными);

- частная корреляция - зависимость между результативным и одним факторным признаками при фиксированном значении других факторных признаков;

- множественная корреляция - зависимость результативного и двух или более факторных признаков, включенных в исследование.

Задачей корреляционного анализа является количественное определение тесноты связи между двумя признаками (при парной связи) и между результативным и множеством факторных признаков (при многофакторной связи).

Теснота связи количественно выражается величиной коэффициентов корреляции, которые давая количественную характеристику тесноты связи между признаками, позволяют определять «полезность» факторных признаков при построении уравнения множественной регрессии.

Корреляция взаимосвязана с регрессией, поскольку первая оценивает силу (тесноту) статистической связи, вторая исследует ее форму.

Регрессионный анализ заключается в определении аналитического выражения связи в виде уравнения регрессии.

Регрессией называется зависимость среднего значения случайной величины результативного признака от величины факторного, а уравнением регрессии – уравнение описывающее корреляционную зависимость между результативным признаком и одним или несколькими факторными.

Формулы корреляционно-регрессионного анализа для прямолинейной связи при парной корреляции представлены в таблице 2.

| Показатель | Обозначение и формула |

|---|---|

| Уравнение прямой при парной корреляции | y x = a +bx, где b - коэффициент регрессии |

| Система нормальных уравнений способом наименьших квадратов для определения коэффициентов a и b | |

| Линейный коэффициент корреляции для определения тесноты связи, его интерпретация: r = 0 – связь отсутствует; 0 -1 r = 1 – связь функциональная |

|

| Эластичность абсолютная | |

| Эластичность относительная |  |

Примеры решения задач по теме «Основы корреляционного анализа»

Задача 1 (анализ прямолинейной связи при парной корреляции) . Имеются данные о квалификации и месячной выработке пяти рабочих цеха:

Для изучения связи между квалификацией рабочих и их выработкой определить линейное уравнение связи и коэффициент корреляции. Дать интерпретацию коэффициентам регрессии и корреляции.

Решение . Расширим предлагаемую таблицу.

Определим параметры уравнения прямой y x = a +bx . Для этого решим систему уравнений:

Значит коэффициент регрессии равен 18.

Поскольку в - положительное число, то имеется прямая связь между параметрами x и у.

а=92-4×18

а=20

Линейное уравнение связи имеет вид у х =20+18х.

Для определения тесноты (силы) связи между изучаемыми признаками определим величину коэффициента корреляции по формуле:

= (2020-20×460/5)/(√10×√3280) ≈ 180/181,11=0,99. Поскольку коэффициент корреляции больше 0,7, то связь в данном ряду сильная.

Задача 2 . На предприятии цены на изделия снижены с 80 руб. за единицу до 60 руб. После снижения цен продажа возросла с 400 до 500 единиц в день. Определить абсолютную и относительную эластичность. Сделать оценку эластичности с целью возможности (или невозможности) дальнейшего снижения цен.

Решение . Рассчитаем показатели, позволяющие провести предварительный анализ эластичности:

Как видим, темпы снижения цены равны по абсолютной величине темпам увеличения спроса.

Абсолютную и относительную эластичность найдем по формулам:

= (500-400)/(60-80) =100/(-20) -5 - эластичность абсолютная

= (100:400)/(-20:80) = -1 - эластичность относительная

Модуль относительной эластичности равен 1. Это подтверждает тот факт, что темп роста спроса равен темпу снижения цены. В такой ситуации вычислим выручку, получаемую предприятием ранее и после снижения цены: 80*400 = 32 000 руб. в день, 60*500 = 30 000 руб. в день – как видим, выручка снизилась и дальнейшее снижение цен не является целесообразным.

Основные понятия корреляционного анализа

Выделяют несколько видов связи между переменными:

Корреляционная зависимость предполагает взаимную согласованность изменений переменных величин, а также то, что эти изменения можно измерить однократно или многократно (в данном случае говорят о плотности связи переменных, но не о причинно-следственных связях); например, в современном российском обществе чем выше возраст, тем ниже социальный статус человека; отдельные проявления геронтократии эту закономерность не нарушают.

Функциональное воздействие предполагает, что изменения независимой переменной сопровождаются все более ускоряющимися изменениями зависимой переменной (причинно-следственные связи фиксируют влияние независимой переменной на зависимую); например, чем более радикальными политическими взглядами обладает человек, тем в большей степени он не приемлет существующий политический режим; в то же время нельзя утверждать, что чем в большей степени человек негативно оценивает власть, тем более радикальными взглядами он обладает.

Функциональная зависимость - связь переменных, означающая, что изменение одной переменной оказывает воздействие на изменение другой, которая в свою очередь воздействует на первую переменную, т.е. это связи взаимодействия; например, информированность человека о политике напрямую связана с интересом к ней; чем больше человек политикой интересуется, тем больше в ней разбирается.

Связь может быть нелинейной и немонотонной.

Каким бы в итоге ни оказался тип связи между переменными, необходимо убедиться в ее наличии в принципе. Корреляционный анализ применяется для выяснения взаимодействия и тенденций изменения характеристик изучаемого явления.

Первоначальной стадией его развития считается период 1870- 1880-х годов, а автором понятия «коэффициент корреляции» - Фрэнсис Гальтон. Наиболее серьезные разработки в области корреляционного анализа на рубеже XIX-XX вв. выполнил Карл Пирсон. Традиционно кбрреляционный анализ используется для проверки гипотезы о статистической зависимости двух или нескольких переменных. В качестве вспомогательного средства анализ корреляций можно использовать при проверке пригодности экспериментальных гипотез и для включения переменных в факторный и регрессионный анализ. Корреляционный анализ осуществляется с помощью сравнения и сопоставления рядов распределения, построенных на основании группировок по различным признакам.

Корреляция - наличие статистической взаимосвязи признаков, когда каждому определенному значению одного признака X соответствует определенное значение У (или комплекс значений К-ряда распределения). Корреляционный анализ выясняет функциональную зависимость между переменными величинами, которая характеризуется тем, что каждому значению одной из них соответствует вполне опреде- тенпое значение другой. Однако корреляционный анализ не предполагает выявления каузальных связей, поэтому при интерпретации ре- 1ультатов формулировки типа «переменная х влияет на переменную у» или «переменная х зависит от переменной у» недопустимы.

Различают парную и множественную корреляции. Парная корреляция характеризует тип, форму и плотность связи между двумя признаками, множественная - между несколькими.

Корреляционная зависимость возникает чаще всего там, где одно явление находится под воздействием большого числа факторов, действующих с разной силой, поэтому существуют специальные меры корреляционной связи, называемые коэффициентами корреляции. Коэффициенты (в статистике их общее количество исчисляется десятками) показывают степень взаимосвязи явлений (плотность корреляционной связи, иногда исследователи говорят об интенсивности связи) и характер этой связи (направленность ). Связь может быть прямой и обратной. Например, чем старше избиратель, тем более активно он участвует в выборах. Чем выше уровень доходов людей, тем в меньшей степени они склонны участвовать в выборах в качестве избирателей (обратная связь). Чем выше коэффициент корреляции между двумя переменными, тем точнее можно предсказать значения одной из них по значениям другой. Характер связи также определяется в категориях «монотонная » (направление изменения одной переменной не меняется при изменении второй переменной) и «немонотонная » связь. Помимо оценки плотности и направленности связи необходимо учитывать надежность (достоверность ) связи.

Корреляционный анализ последовательно решает три практические задачи:

определение корреляционного поля и составление корреляционной (в данном случае это комбинированная) таблицы;

вычисление выборочных корреляционных отношений или коэффициентов корреляции;

проверка статистической гипотезы значимости связи.

Коэффициент корреляции не содержит информации о том, является ли данная связь между ними причинно-следственной или сопутствующей (порожденной общей причиной). Этот вопрос исследователь должен решать самостоятельно на основе содержательных представлений о структуре, динамике изучаемых социальных объектов, корреляций между изучаемыми признаками, использовать иные способы статистического анализа (регрессионный, факторный, дискриминантный, путевой и т.д.). Но величина коэффициента позволяет оценить плотность связи как меньшую (незначимую) или большую. По знаку коэффициента корреляции для порядковых рядов мы можем сказать, является ли эта связь прямой или обратной (для номинальных рядов знак коэффициента не несет смысловой нагрузки).

Для установления корреляционной связи между двумя признаками необходимо доказать, что все другие переменные не оказывают воздействия на отношения двух переменных, являющихся предметом изучения. В противном случае возникает ситуация ложной корреляции. Секрет возникновения ложной корреляции заключается в том, что у двух явлений, связь которых формально подкрепляется наличием статистической связи, есть общая причина, в равной степени влияющая на каждое из них.

Корреляционному анализу предшествует стадия расчета статистики х 2 - Но на основании полученного значения статистики х 2 мы ничего не можем сказать о плотности связи анализируемых переменных. Цля решения такой задачи необходимо обратиться к коэффициентам корреляционной связи.

Традиционным для выполнения корреляционного анализа является обращение к коэффициенту корреляции Пирсона (Pearson) Р (в литературе он обозначается и через г).

Если при описании политического объекта определяется лишь наличие или отсутствие признака или если изучается связь между альтернативными признаками, то корреляционные таблицы (таблицы сопряженного признака) - 4-клеточные. В этом случае применяются коэффициент Юла(О) и коэффициент контингенции (ф). Они основаны на принципе совместного появления событий (значений признаков у объекта исследования) и пригодны для анализа любых признаков (метрических, порядковых и даже номинальных).

В случае если номинальные шкалы имеют большее число значений, чем два, то для определения зависимости между признаками пользуются коэффициентами сопряженности Пирсона (Р ), Чупрова (7) и Крамера (К). При этом определенное значение имеет размерность таблицы с на к, в которой отображены значения двух признаков. Коэффициенты Чупрова и Крамера считаются более «строгими», чем коэффициент сопряженности Пирсона. Но поскольку вычисления в них строятся с учетом статистики х 2 , то все связанные с ней ограничения распространяются и на эти коэффициенты.

Множественный коэффициент корреляции (IV), который иногда называют коэффициентом конкордации, применяется для оценки согласованности двух или нескольких рядов ранжированных значений переменных.

Вариантов расчета коэффициентов корреляции между признаками в статистическом пакете SPSS два.

Функциональная зависимость и корреляция . Еще Гиппократ в VI в. до н. э. обратил внимание на наличие связи между телосложением и темпераментом людей, между строением тела и предрасположенностью к тем или иным заболеваниям. Определенные виды подобной связи выявлены также в животном и растительном мире. Так, существует зависимость между телосложением и продуктивностью у сельскохозяйственных животных; известна связь между качеством семян и урожайностью культурных растений и т.д. Что же касается подобных зависимостей в экологии, то существуют зависимости между содержанием тяжелых металлов в почве и снежном покрове от их концентрации в атмосферном воздухе и т.п. Поэтому естественно стремление использовать эту закономерность в интересах человека, придать ей более или менее точное количественное выражение.

Как известно, для описания связей между переменными величинами применяют математические понятие функции f , которая ставит в соответствие каждому определенному значению независимой переменной x определенное значение зависимой переменной y , т.е. . Такого рода однозначные зависимости между переменными величинамиx и y называют функциональными . Однако такого рода связи в природных объектах встречаются далеко не всегда. Поэтому зависимость между биологическими, а также и экологическими признаками имеет не функциональный, а статистический характер, когда в массе однородных индивидов определенному значению одного признака, рассматриваемого в качестве аргумента, соответствует не одно и то же числовое значение, а целая гамма распределяющихся в вариационный ряд числовых значений другого признака, рассматриваемого в качестве зависимой переменной, или функции. Такого рода зависимость между переменными величинами называется корреляционной или корреляцией..

Функциональные связи легко обнаружить и измерить на единичных и групповых объектах, однако этого нельзя проделать с корреляционными связями, которые можно изучать только на групповых объектах методами математической статистики. Корреляционная связь между признаками бывает линейной и нелинейной, положительной и отрицательной. Задача корреляционного анализа сводится к установлению направления и формы связи между варьирующими признаками, измерению ее тесноты и, наконец, к проверке достоверности выборочных показателей корреляции.

Зависимость между переменными X и Y можно выразить аналитически (с помощью формул и уравнений) и графически (как геометрическое место точек в системе прямоугольных координат). График корреляционной зависимости строят по уравнению функции или, которая называетсярегрессией . Здесь и– средние арифметические, найденные при условии, чтоX или Y примут некоторые значения x или y . Эти средние называются условными .

11.1. Параметрические показатели связи

Коэффициент корреляции . Сопряженность между переменными величинами x и y можно установить, сопоставляя числовые значения одной из них с соответствующими значениями другой. Если при увеличении одной переменной увеличивается другая, это указывает на положительную связь между этими величинами, и наоборот, когда увеличение одной переменной сопровождается уменьшением значения другой, это указывает на отрицательную связь .

Для характеристики связи, ее направления и степени сопряженности переменных применяют следующие показатели:

линейной зависимость – коэффициент корреляции ;

нелинейный – корреляционной отношение .

Для определения эмпирического коэффициента корреляции используют следующую формулу:

![]() .

(1)

.

(1)

Здесь s x и s y – средние квадратические отклонения.

Коэффициент корреляции можно вычислить, не прибегая к расчету средних квадратических отклонений, что упрощает вычислительную работу, по следующей аналогичной формуле:

![]() . (2)

. (2)

Коэффициент корреляции – безразмерное число, лежащее в пределах от –1 до +1. При независимом варьировании признаков, когда связь между ними полностью отсутствует, . Чем сильнее сопряженность между признаками, тем выше значение коэффициента корреляции. Следовательно, приэтот показатель характеризует не только наличие, но и степень сопряженности между признаками. При положительной или прямой связи, когда большим значениям одного признака соответствуют большие же значения другого, коэффициент корреляции имеет положительный знак и находится в пределах от 0 до +1, при отрицательной или обратной связи, когда большим значениям одного признака соответствуют меньшие значения другого, коэффициент корреляции сопровождается отрицательным знаком и находится в пределах от 0 до –1.

Коэффициент корреляции нашел широкое применение в практике, но он не является универсальным показателем корреляционных связей, так как способен характеризовать только линейные связи, т.е. выражаемые уравнением линейной регрессии (см. тему 12). При наличии нелинейной зависимости между варьирующими признаками применяют другие показатели связи, рассмотренных ниже.

Вычисление коэффициента корреляции . Это вычисление производят разными способами и по-разному в зависимости от числа наблюдений (объема выборки). Рассмотрим отдельно специфику вычисления коэффициента корреляции при наличии малочисленных выборок и выборок большого объема.

Малые выборки . При наличии малочисленных выборок коэффициент корреляции вычисляют непосредственно по значениям сопряженных признаков, без предварительной группировки выборочных данных в вариационные ряды. Для этого служат приведенные выше формулы (1) и (2). Более удобными, особенно при наличии многозначных и дробных чисел, которыми выражаются отклонения вариант х i и y i от средних и, служат следующие рабочие формулы:

где

![]() ;

;

![]() ;

;

Здесь x i и y i – парные варианты сопряженных признаков x и y ; и –средние арифметические;– разность между парными вариантами сопряженных признаковx и y ; n – общее число парных наблюдений, или объем выборочной совокупности.

Эмпирический коэффициент корреляции, как и любой другой выборочный показатель, служит оценкой своего генерального параметра ρ и как величина случайная сопровождается ошибкой:

Отношение выборочного коэффициента корреляции к своей ошибке служит критерием для проверки нулевой гипотезы – предположения о том, что в генеральной совокупности этот параметр равен нулю, т.е. . Нулевую гипотезу отвергают на принятом уровне значимостиα , если

Значения критических точек t st для разных уровней значимости α и чисел степеней свободы приведены в табл.1 Приложений.

Установлено, что при обработке малочисленных выборок (особенно когда n < 30 ) расчет коэффициента корреляции по формулам (1) – (3) дает несколько заниженные оценки генерального параметра ρ , т.е. необходимо внести следующую поправку:

z-преобразование Фишера . Правильное применение коэффициента корреляции предполагает нормальное распределение двумерной совокупности сопряженных значений случайных величин x и y . Из математической статистики известно, что при наличии значительной корреляции между переменными величинами, т.е. когда R xy > 0,5 выборочное распределение коэффициента корреляции для большего числа малых выборок, взятых из нормально распределяющейся генеральной совокупности, значительно отклоняются от нормальной кривой.

Учитывая это обстоятельство, Р. Фишер нашел более точный способ оценки генерального параметра по значению выборочного коэффициента корреляции. Этот способ сводится к замене R xy преобразованной величиной z, которая связана с эмпирическим коэффициентом корреляции, следующим образом:

Распределение величины z является почти неизменным по форме, так как мало зависит от объема выборки и от значения коэффициента корреляции в генеральной совокупности, и приближается к нормальному распределению.

Критерием достоверности показателя z является следующее отношение:

Нулевая гипотеза отвергается на принятом уровне значимости α и числе степеней свободы . Значения критических точекt st приведены в табл.1 Приложений.

Применение z-преобразования позволяет с большей уверенностью оценивать статистическую значимость выборочного коэффициента корреляции, а также и разность между эмпирическими коэффициентами , когда в этом возникает необходимость.

Минимальный объем выборки для точной оценки коэффициента корреляции. Можно рассчитать объем выборки для заданного значения коэффициента корреляции, который был бы достаточен для опровержения нулевой гипотезы (если корреляция между признаками Y и X действительно существует). Для этого служит следующая формула:

где n – искомый объем выборки; t – величина, заданная по принятому уровню значимости (лучше для α = 1%); z – преобразованный эмпирический коэффициент корреляции.

Большие выборки . При наличии многочисленных исходных данных их приходится группировать в вариационные ряды и, построив корреляционную решетку, разность по ее клеткам (ячейкам) общие частоты сопряженных рядов. Корреляционная решетка образуется пересечением строк и столбцов, число которых равно числу групп или классов коррелируемых рядов. Классы располагаются в верхней строке и в первой (слева) столбце корреляционной таблицы, а общие частоты, обозначаемые символом f xy , – в клетках корреляционной решетки, составляющей основную часть корреляционной таблицы.

Классы, помещенные в верхней строке таблицы, обычно располагаются слева направо в возрастающем порядке, а в первом столбце таблицы – сверху вниз в убывающем порядке. При таком расположении классов вариационных рядов их общие частоты (при наличии положительной связи между признаками Y и X ) будут распределяться по клеткам решетки в виде эллипса по диагонали от нижнего левого угла к верхнему правому углу решетки или (при наличии отрицательной связи между признаками) в направлении от верхнего левого угла к нижнему правому углу решетки. Если же частоты f xy распределяются по клеткам корреляционной решетки более или менее равномерно, не образуя фигуры эллипса, это будет указывать на отсутствие корреляции между признаками.

Распределение частот f xy по клеткам корреляционной решетки дает лишь общее представление о наличии или отсутствии связи между признаками. Судить о тесноте или менее точно лишь по значению и знаку коэффициента корреляции . При вычислении коэффициента корреляции с предварительной группировки выборочных данных в интервальные вариационные ряды не следует брать слишком широкие классовые интервалы. Грубая группировка гораздо сильнее сказывается на значении коэффициента корреляции, чем это имеет место при вычислении средних величин и показателей вариации.

Напомним, что величина классового интервала определяется по формуле

где x max , x min – максимальная и минимальная варианты совокупности; К – число классов, на которые следует разбить вариацию признака. Опыт показал, что в области корреляционного анализа величину К можно поставить в зависимость от объема выборки примерно следующим образом (табл.1).

Таблица 1

|

Объем выборки |

Значение К |

|

50 ≥ n > 30 |

|

|

100 ≥ n > 50 | |

|

200 ≥ n > 100 | |

|

300 ≥ n > 200 |

Как и другие статистические характеристики, вычисляемые с предварительной группировкой исходных данных в вариационные ряды, коэффициент корреляции определяют разными способами, дающими совершенно идентичные результаты.

Способ произведений . Коэффициент корреляции можно вычислить используя основные формулы (1) или (2), внеся в них поправку на повторяемость вариант в димерной совокупности. При этом, упрощая символику, отклонения вариант от их средних обозначим через а , т.е. и. Тогда формула (2) с учетом повторяемости отклонений примет следующее выражение:

Достоверность этого показателя оценивается с помощью критерия Стьюдента, который представляет отношение выборочного коэффициента корреляции к своей ошибке, определяемой по формуле

Отсюда и если эта величина превышает стандартное значение критерия Стьюдентаt st для степени свободы и уровне значимостиα (см. Таблицу 2 Приложений), то нулевую гипотезу отвергают.

Способ условных средних . При вычислении коэффициента корреляции отклонения вариант (“классов”) можно находить не только от средних арифметических и, но и от условных средних А х и A y . При этом способе в числитель формулы (2) вносят поправку и формула приобретает следующий вид:

где f xy – частоты классов одного и другого рядов распределения; и, т.е. отклонения классов от условных средних, отнесенные к величине классовых интерваловλ ; n – общее число парных наблюдений, или объем выборки; и– условные моменты первого порядка, гдеf x – частоты ряда Х , а f y – частоты ряда Y ; s x и s y – средние квадратические отклонения рядов X и Y , вычисляемые по формуле .

Способ условных средних имеет преимущество перед способом произведений, так как позволяет избегать операции с дробными числами и придавать один и тот же (положительный) знак отклонениям a x и a y , что упрощает технику вычислительной работы, особенно при наличии многозначных чисел.

Оценка разности между коэффициентами корреляции . При сравнении коэффициентов корреляции двух независимых выборок нулевая гипотеза сводится к предположению о том, что в генеральной совокупности разница между этими показателями равна нулю. Иными словами, следует исходить из предположения, что разница, наблюдаемая между сравниваемыми эмпирическими коэффициентами корреляции, возникла случайно.

Для проверки нулевой гипотезы служит t-критерий Стьюдента, т.е. отношение разности между эмпирическими коэффициентами корреляции R 1 и R 2 к своей статистической ошибке, определяемой по формуле:

где s R1 и s R2 – ошибки сравниваемых коэффициентов корреляции.

Нулевая гипотеза опровергается при условии, что для принятого уровне значимостиα и числе степеней свободы .

Известно, что более точную оценку достоверности коэффициента корреляции получают при переводе R xy в число z . Не является исключением и оценка разности между выборочными коэффициентами корреляции R 1 и R 2 , особенно в тех случаях, когда последние вычислены на выборках сравнительно небольшого объема (n < 100 ) и по своему абсолютному значению значительно превышают 0,50.

Разность оценивают с помощью t-критерия Стьюдента, который строят по отношению этой разности к своей ошибке, вычисляемой по формуле

Нулевую гипотезу отвергают, если дляи принятого уровня значимостиα.

Корреляционное отношение . Для измерения нелинейной зависимости между переменными x и y используют показатель, который называют корреляционным отношением , который описывает связь двусторонне. Конструкция корреляционного отношения предполагает сопоставление двух видов вариации: изменчивости отдельных наблюдений по отношению к частным средним и вариации самих частных средних по сравнению с общей средней величиной. Чем меньшую часть составит первый компонент по отношению ко второму, тем теснота связи окажется большей. В пределе, когда никакой вариации отдельных значений признака возле частных средних не будет наблюдаться, теснота связи окажется предельно большой. Аналогичным образом, при отсутствии изменчивости частных средних теснота связи окажется минимальной. Так как это соотношение вариации может быть рассмотрено для каждого из двух признаков, получается два показателя тесноты связи – h yx и h xy . Корреляционное отношение является величиной относительной и может принимать значения от 0 до 1. При этом коэффициенты корреляционного отношения обычно не равны друг другу, т.е. . Равенство между этими показателями осуществимо только при строго линейной зависимости между признаками. Корреляционное отношение является универсальным показателем: оно позволяет характеризировать любую форму корреляционной связи – и линейную, и нелинейную.

Коэффициенты корреляционного отношения h yx и h xy определяют рассмотренными выше способами, т.е. способом произведений и способом условных средних.

При наличии двух рядов значений, подвергающихся ранжированию, рационально рассчитывать ранговую корреляцию Спирмена.

Такие ряды могут представляться:

- парой признаков, определяемых в одной и той же группе исследуемых объектов;

- парой индивидуальных соподчиненных признаков, определяемых у 2 исследуемых объектов по одинаковому набору признаков;

- парой групповых соподчиненных признаков;

- индивидуальной и групповой соподчиненностью признаков.

Метод предполагает проведение ранжирования показателей в отдельности для каждого из признаков.

Наименьшее значение имеет наименьший ранг.

Этот метод относится к непараметрическому статистическому методу, предназначенному для установления существования связи изучаемых явлений:

- определение фактической степени параллелизма между двумя рядами количественных данных;

- оценка тесноты выявленной связи, выражаемой количественно.

Корреляционный анализ

Статистический метод, предназначенный для выявления существования зависимости между 2 и более случайными величинами (переменными), а также ее силы, получил название корреляционного анализа.

Получил свое название от correlatio (лат.) – соотношение.

При его использовании возможны варианты развития событий:

- наличие корреляции (положительная либо отрицательная);

- отсутствие корреляции (нулевая).

В случае установления зависимости между переменными речь идет об их коррелировании. Иными словами, можно сказать, что при изменении значения Х, обязательно будет наблюдаться пропорциональное изменение значения У.

В качестве инструментов используются различные меры связи (коэффициенты).

На их выбор оказывает влияние:

- способ измерения случайных чисел;

- характер связи между случайными числами.

Существование корреляционной связи может отображаться графически (графики) и с помощью коэффициента (числовое отображение).

Корреляционная связь характеризуется такими признаками:

- сила связи (при коэффициенте корреляции от ±0,7 до ±1 – сильная; от ±0,3 до ±0,699 – средняя; от 0 до ±0,299 – слабая);

- направление связи (прямая или обратная).

Цели корреляционного анализа

Корреляционный анализ не позволяет установить причинную зависимость между исследуемыми переменными.

Он проводится с целью:

- установления зависимости между переменными;

- получения определенной информации о переменной на основе другой переменной;

- определения тесноты (связи) этой зависимости;

- определение направления установленной связи.

Методы корреляционного анализа

Данный анализ может выполняться с использованием:

Данный анализ может выполняться с использованием:

- метода квадратов или Пирсона;

- рангового метода или Спирмена.

Метод Пирсона применим для расчетов требующих точного определения силы, существующей между переменными. Изучаемые с его помощью признаки должны выражаться только количественно.

Для применения метода Спирмена или ранговой корреляции нет жестких требований в выражении признаков – оно может быть, как количественным, так и атрибутивным. Благодаря этому методу получается информация не о точном установлении силы связи, а имеющая ориентировочный характер.

В рядах переменных могут содержаться открытые варианты. Например, когда стаж работы выражается такими значениями, как до 1 года, более 5 лет и т.д.

Коэффициент корреляции

Статистическая величина характеризующая характер изменения двух переменных получила название коэффициента корреляции либо парного коэффициента корреляции. В количественном выражении он колеблется в пределах от -1 до +1.

Наиболее распространены коэффициенты:

- Пирсона – применим для переменных принадлежащих к интервально шкале;

- Спирмена – для переменных порядковой шкалы.

Ограничения использования коэффициента корреляции

Получение недостоверных данных при расчете коэффициента корреляции возможно в тех случаях, когда:

- в распоряжении имеется достаточное количество значений переменной (25-100 пар наблюдений);

- между изучаемыми переменными установлено, например, квадратичное соотношение, а не линейное;

- в каждом случае данные содержат больше одного наблюдения;

- наличие аномальных значений (выбросов) переменных;

- исследуемые данные состоят из четко выделяемых подгрупп наблюдений;

- наличие корреляционной связи не позволяет установить какая из переменных может рассматриваться в качестве причины, а какая – в качестве следствия.

Проверка значимости корреляции

Для оценки статистических величин используется понятие их значимости или же достоверности, характеризующей вероятность случайного возникновения величины либо крайних ее значений.

Наиболее распространенным методом определения значимости корреляции является определение критерия Стьюдента.

Его значение сравнивается с табличным, количество степенней свободы принимается как 2. При получении расчетного значения критерия больше табличного, свидетельствует о значимости коэффициента корреляции.

При проведении экономических расчетов достаточным считается доверительный уровень 0,05 (95%) либо 0,01 (99%).

Ранги Спирмена

Коэффициент ранговой корреляции Спирмена позволяет статистически установить наличие связи между явлениями. Его расчет предполагает установление для каждого признака порядкового номера – ранга. Ранг может быть возрастающим либо убывающим.

Количество признаков, подвергаемых ранжированию, может быть любым. Это достаточно трудоемкий процесс, ограничивающий их количество. Затруднения начинаются при достижении 20 признаков.

Для расчета коэффициента Спирмена пользуются формулой:

в которой:

n – отображает количество ранжируемых признаков;

d – не что иное как разность между рангами по двум переменным;

а ∑(d2) – сумма квадратов разностей рангов.

Применение корреляционного анализа в психологии

Статистическое сопровождение психологических исследований позволяет сделать их более объективными и высоко репрезентативными. Статистическая обработка данных полученных в ходе психологических экспериментов способствует извлечению максимума полезной информации.

Наиболее широкое применение в обработке их результатов получил корреляционный анализ.

Уместным является проведение корреляционного анализа результатов, полученных при проведении исследований:

- тревожности (по тестам R. Temml, M. Dorca, V. Amen);

- семейных взаимоотношений («Анализ семейных взаимоотношений» (АСВ) опросник Э.Г. Эйдемиллера, В.В. Юстицкиса);

- уровня интернальности-экстернальности (опросник Е.Ф. Бажина, Е.А. Голынкиной и А.М. Эткинда);

- уровня эмоционального выгорания у педагогов (опросник В.В. Бойко);

- связи элементов вербального интеллекта учащихся при разно профильном обучении (методика К.М. Гуревича и др.);

- связи уровня эмпатии (методика В.В. Бойко) и удовлетворенностью браком (опросник В.В. Столина, Т.Л. Романовой, Г.П. Бутенко);

- связи между социометрическим статусом подростков (тест Jacob L. Moreno) и особенностями стиля семейного воспитания (опросник Э.Г. Эйдемиллера, В.В. Юстицкиса);

- структуры жизненных целей подростков, воспитанных в полных и неполных семьях (опросник Edward L. Deci, Richard M. Ryan Ryan).

Краткая инструкция к проведению корреляционного анализа по критерию Спирмена

Проведение корреляционного анализа с использованием метода Спирмена выполняется по следующему алгоритму:

- парные сопоставимые признаки располагаются в 2 ряда, один из которых обозначается с помощью Х, а другой У;

- значения ряда Х располагаются в порядке возрастания либо убывания;

- последовательность расположения значений ряда У определяется их соответствием значений ряда Х;

- для каждого значения в ряду Х определить ранг — присвоить порядковый номер от минимального значения к максимальному;

- для каждого из значений в ряду У также определить ранг (от минимального к максимальному);

- вычислить разницу (D) между рангами Х и У, прибегнув к формуле D=Х-У;

- полученные значения разницы возводятся в квадрат;

- выполнить суммирование квадратов разниц рангов;

- выполнить расчеты по формуле:

Пример корреляции Спирмена

Необходимо установить наличие корреляционной связи между рабочим стажем и показателем травматизма при наличии следующих данных:

Наиболее подходящим методом анализа является ранговый метод, т.к. один из признаков представлен в виде открытых вариантов: рабочий стаж до 1 года и рабочий стаж 7 и более лет.

Решение задачи начинается с ранжирования данных, которые сводятся в рабочую таблицу и могут быть выполнены вручную, т.к. их объем не велик:

| Рабочий стаж | Число травм | Порядковые номера | (ранги) | Разность рангов | Квадрат разности рангов |

| d(х-у) | |||||

| до 1 года | 24 | 1 | 5 | -4 | 16 |

| 1-2 | 16 | 2 | 4 | -2 | 4 |

| 3-4 | 12 | 3 | 2,5 | +0,5 | 0,25 |

| 5-6 | 12 | 4 | 2,5 | +1,5 | 2,5 |

| 7 и более | 6 | 5 | 1 | +4 | 16 |

| Σ d2 = 38,5 |

Появление дробных рангов в колонке связано с тем, что в случае появления вариант одинаковых по величине находится среднее арифметическое значение ранга. В данном примере показатель травматизма 12 встречается дважды и ему присваиваются ранги 2 и 3, находим среднее арифметическое этих рангов (2+3)/2= 2,5 и помещаем это значение в рабочую таблицу для 2 показателей.

Выполнив подстановку полученных значений в рабочую формулу и произведя несложные расчёты получаем коэффициент Спирмена равный -0,92

Отрицательное значение коэффициента свидетельствует о наличии обратной связи между признаками и позволяет утверждать, что небольшой стаж работы сопровождается большим числом травм. Причем, сила связи этих показателей достаточно большая.

Следующим этапом расчётов является определение достоверности полученного коэффициента:

рассчитывается его ошибка и критерий Стьюдента

КУРСОВАЯ РАБОТА

Тема: Корреляционный анализ

Введение

1. Корреляционный анализ

1.1 Понятие корреляционной связи

1.2 Общая классификация корреляционных связей

1.3 Корреляционные поля и цель их построения

1.4 Этапы корреляционного анализа

1.5 Коэффициенты корреляции

1.6 Нормированный коэффициент корреляции Браве-Пирсона

1.7 Коэффициент ранговой корреляции Спирмена

1.8 Основные свойства коэффициентов корреляции

1.9 Проверка значимости коэффициентов корреляции

1.10 Критические значения коэффициента парной корреляции

2. Планирование многофакторного эксперимента

2.1 Условие задачи

2.2 Определение центр плана (основной уровень) и уровня варьирования факторов

2.3 Построение матрицы планирования

2.4 Проверка однородности дисперсии и равноточности измерения в разных сериях

2.5 Коэффициенты уравнения регрессии

2.6 Дисперсия воспроизводимости

2.7 Проверка значимости коэффициентов уравнения регрессии

2.8 Проверка адекватности уравнения регрессии

Заключение

Список литературы

ВВЕДЕНИЕ

Планирование эксперимента -математико-статистическая дисциплина, изучающая методы рациональной организации экспериментальных исследований - от оптимального выбора исследуемых факторов и определения собственно плана эксперимента в соответствии с его целью до методов анализа результатов. Начало планирования эксперимента положили труды английского статистика Р.Фишера (1935), подчеркнувшего, что рациональное планирование экспериментадаёт не менее существенный выигрыш в точности оценок, чем оптимальная обработка результатов измерений. В 60-х годах 20 века сложилась современная теория планирования эксперимента. Её методы тесно связаны с теорией приближения функций и математическим программированием. Построены оптимальные планы и исследованы их свойства для широкого класса моделей.

Планирование эксперимента – выбор плана эксперимента, удовлетворяющего заданным требованиям, совокупность действий направленных на разработку стратегии экспериментирования (от получения априорной информации до получения работоспособной математической модели или определения оптимальных условий). Это целенаправленное управление экспериментом, реализуемое в условиях неполного знания механизма изучаемого явления.

В процессе измерений, последующей обработки данных, а также формализации результатов в виде математической модели, возникают погрешности и теряется часть информации, содержащейся в исходных данных. Применение методов планирования эксперимента позволяет определить погрешность математической модели и судить о ее адекватности. Если точность модели оказывается недостаточной, то применение методов планирования эксперимента позволяет модернизировать математическую модель с проведением дополнительных опытов без потери предыдущей информации и с минимальными затратами.

Цель планирования эксперимента – нахождение таких условий и правил проведения опытов при которых удается получить надежную и достоверную информацию об объекте с наименьшей затратой труда, а также представить эту информацию в компактной и удобной форме с количественной оценкой точности.

Среди основных методов планирования, применяемых на разных этапах исследования, используют:

Планирование отсеивающего эксперимента, основное значение которого выделение из всей совокупности факторов группы существенных факторов, подлежащих дальнейшему детальному изучению;

Планирование эксперимента для дисперсионного анализа, т.е. составление планов для объектов с качественными факторами;

Планирование регрессионного эксперимента, позволяющего получать регрессионные модели (полиномиальные и иные);

Планирование экстремального эксперимента, в котором главная задача – экспериментальная оптимизация объекта исследования;

Планирование при изучении динамических процессов и т.д.

Целью изучения дисциплины является подготовка студентов к производственно-технической деятельности по специальности с применением методов теории планирования и современных информационных технологий.

Задачи дисциплины: изучение современных методов планирования, организации и оптимизации научного и промышленного эксперимента, проведения экспериментов и обработки полученных результатов.

1. КОРРЕЛЯЦИОННЫЙ АНАЛИЗ

1.1 Понятие корреляционной связи

Исследователя нередко интересует, как связаны между собой две или большее количество переменных в одной или нескольких изучаемых выборках. Например, может ли рост влиять на вес человека или может ли давление влиять на качество продукции?

Такого рода зависимость между переменными величинами называется корреляционной, или корреляцией. Корреляционная связь - это согласованное изменение двух признаков, отражающее тот факт, что изменчивость одного признака находится в соответствии с изменчивостью другого.

Известно, например, что в среднем между ростом людей и их весом наблюдается положительная связь, и такая, что чем больше рост, тем больше вес человека. Однако из этого правила имеются исключения, когда относительно низкие люди имеют избыточный вес, и, наоборот, астеники, при высоком росте имеют малый вес. Причиной подобных исключений является то, что каждый биологический, физиологический или психологический признак определяется воздействием многих факторов: средовых, генетических, социальных, экологических и т.д.

Корреляционные связи - это вероятностные изменения, которые можно изучать только на представительных выборках методами математической статистики. Оба термина - корреляционная связь и корреляционная зависимость - часто используются как синонимы. Зависимость подразумевает влияние, связь - любые согласованные изменения, которые могут объясняться сотнями причин. Корреляционные связи не могут рассматриваться как свидетельство причинно-следственной зависимости, они свидетельствуют лишь о том, что изменениям одного признака, как правило, сопутствуют определенные изменения другого.

Корреляционная зависимость - это изменения, которые вносят значения одного признака в вероятность появления разных значений другого признака.

Задача корреляционного анализа сводится к установлению направления (положительное или отрицательное) и формы (линейная, нелинейная) связи между варьирующими признаками, измерению ее тесноты, и, наконец, к проверке уровня значимости полученных коэффициентов корреляции.

Корреляционные связи различаютсяпо форме, направлению и степени (силе).

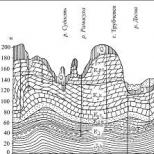

По форме корреляционная связь может быть прямолинейной или криволинейной. Прямолинейной может быть, например, связь между количеством тренировок на тренажере и количеством правильно решаемых задач в контрольной сессии. Криволинейной может быть, например, связь между уровнем мотивации и эффективностью выполнения задачи (рисунок 1). При повышении мотивации эффективность выполнения задачи сначала возрастает, затем достигается оптимальный уровень мотивации, которому соответствует максимальная эффективность выполнения задачи; дальнейшему повышению мотивации сопутствует уже снижение эффективности.

Рисунок 1 - Связь между эффективностью решения задачи и силой мотивационной тенденции

По направлению корреляционная связь может быть положительной ("прямой") и отрицательной ("обратной"). При положительной прямолинейной корреляции более высоким значениям одного признака соответствуют более высокие значения другого, а более низким значениям одного признака - низкие значения другого (рисунок 2). При отрицательной корреляции соотношения обратные (рисунок 3). При положительной корреляции коэффициент корреляции имеет положительный знак, при отрицательной корреляции - отрицательный знак.

Рисунок 2 – Прямая корреляция

Рисунок 3 – Обратная корреляция

Рисунок 4 – Отсутствие корреляции

Степень, сила или теснота корреляционной связи определяется по величине коэффициента корреляции. Сила связи не зависит от ее направленности и определяется по абсолютному значению коэффициента корреляции.

1.2 Общая классификация корреляционных связей

В зависимости от коэффициента корреляции различают следующие корреляционные связи:

Сильная, или тесная при коэффициенте корреляции r>0,70;

Средняя (при 0,50 Умеренная (при 0,30 Слабая (при 0,20 Очень слабая (при r<0,19). 1.3 Корреляционные поля и цель их построения

Корреляция изучается на основании экспериментальных данных, представляющих собой измеренные значения (x i

, y i) двух признаков. Если экспериментальных данных немного, то двумерное эмпирическое распределение представляется в виде двойного ряда значений x i

и y i

. При этом корреляционную зависимость между признаками можно описывать разными способами. Соответствие между аргументом и функцией может быть задано таблицей, формулой, графиком и т. д. Корреляционный анализ, как и другие статистические методы, основан на использовании вероятностных моделей, описывающих поведение исследуемых признаков в некоторой генеральной совокупности, из которой получены экспериментальные значения x i

и y i

. Когда исследуется корреляция между количественными признаками, значения которых можно точно измерить в единицах метрических шкал (метры, секунды, килограммы и т.д.), то очень часто принимается модель двумерной нормально распределенной генеральной совокупности. Такая модель отображает зависимость между переменными величинами x i

и y i

графически в виде геометрического места точек в системе прямоугольных координат. Эту графическую зависимость называются также диаграммой рассеивания или корреляционным полем.

Данная модель двумерного нормального распределения (корреляционное поле) позволяет дать наглядную графическую интерпретацию коэффициента корреляции, т.к. распределение в совокупности зависит от пяти параметров: μ x

, μ y

– средние значения (математические ожидания); σ x

,σ y

– стандартные отклонения случайных величин Х и Y и р – коэффициент корреляции, который является мерой связи между случайными величинами Х и Y.

Если р = 0, то значения, x i

, y i

, полученные из двумерной нормальной совокупности, располагаются на графике в координатах х, у в пределах области, ограниченной окружностью (рисунок 5, а). В этом случае между случайными величинами Х и Y отсутствует корреляция и они называются некоррелированными. Для двумерного нормального распределения некоррелированность означает одновременно и независимость случайных величин Х и Y.